作者: 数据科学家阿宝哥

发布/编辑时间: 2026年04月05日 13:24

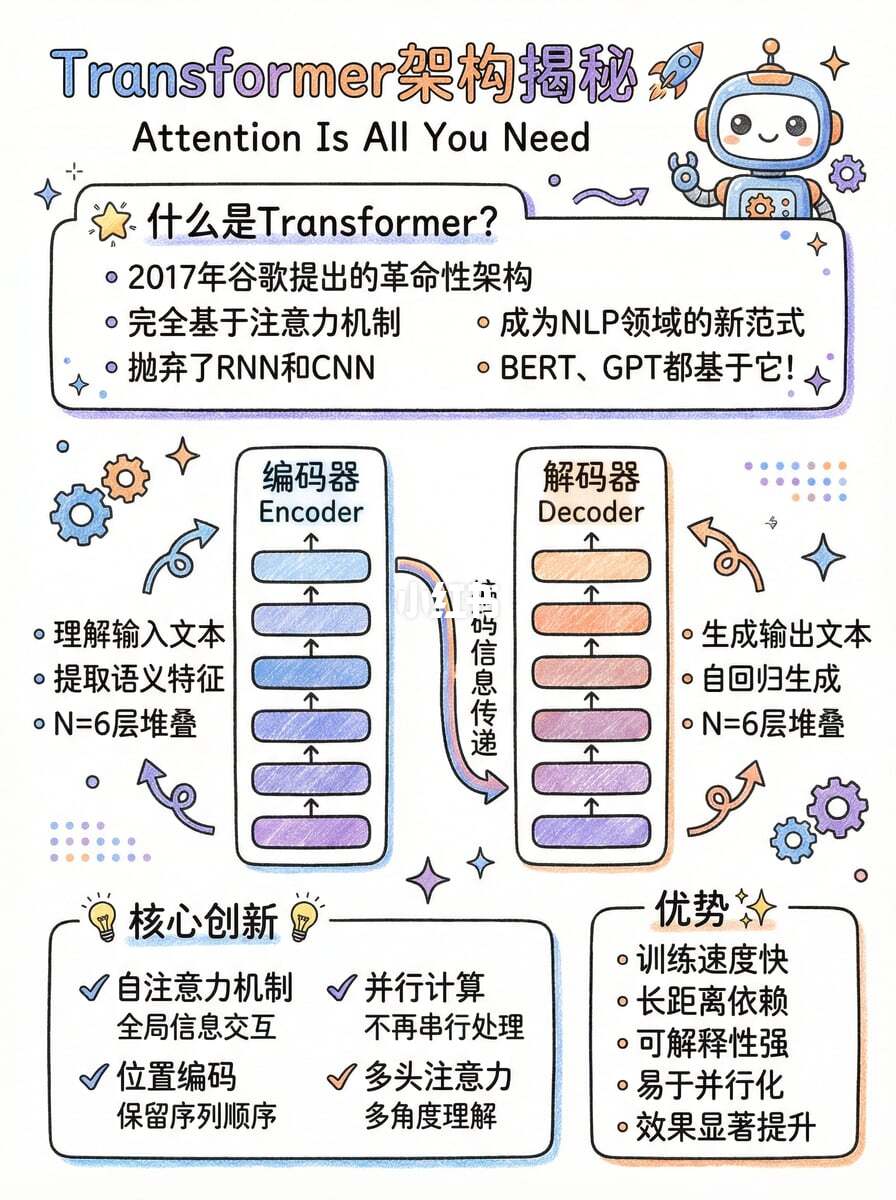

什么是Transformer?

2017年谷歌发布的论文《Attention Is All You Need》彻底改变了NLP领域!它抛弃了传统的RNN和CNN,完全基于注意力机制,实现了并行计算和长距离依赖建模的完美结合。

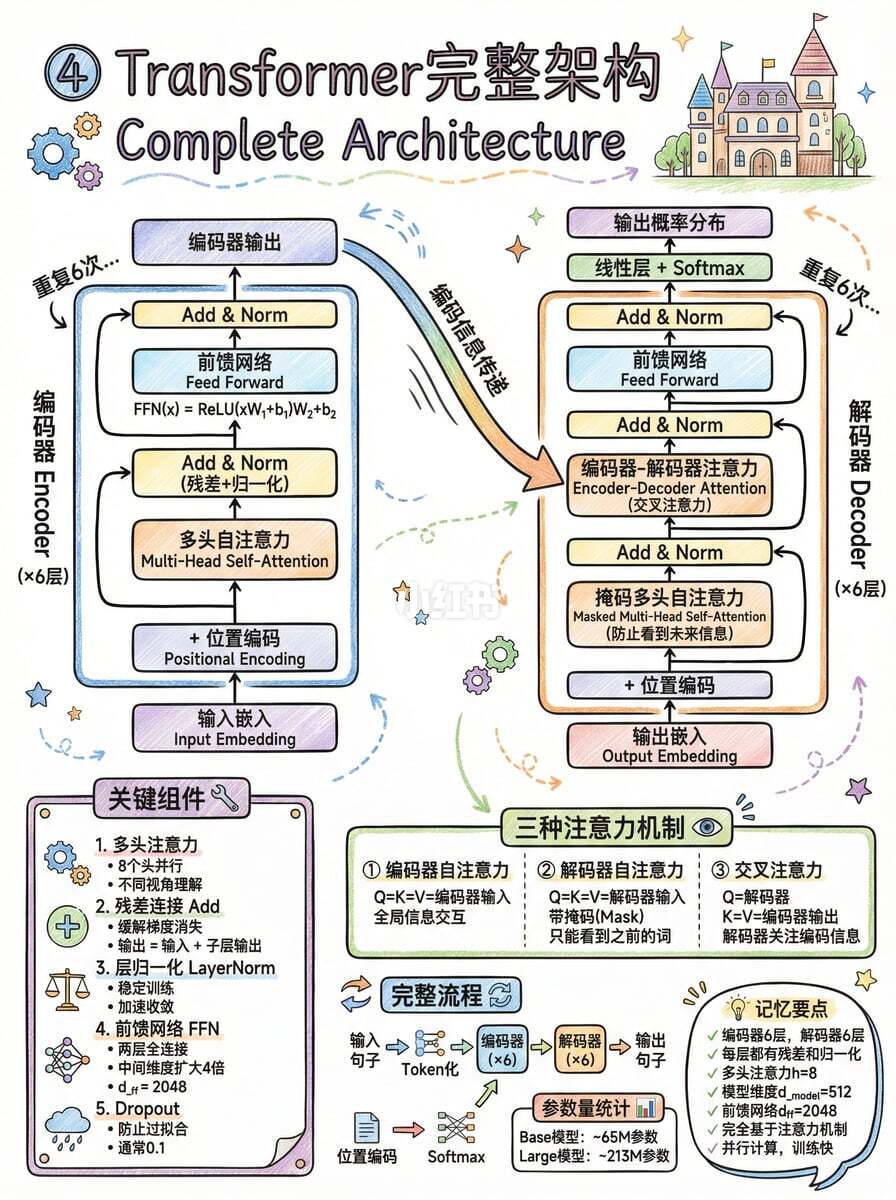

💡 四大核心组件

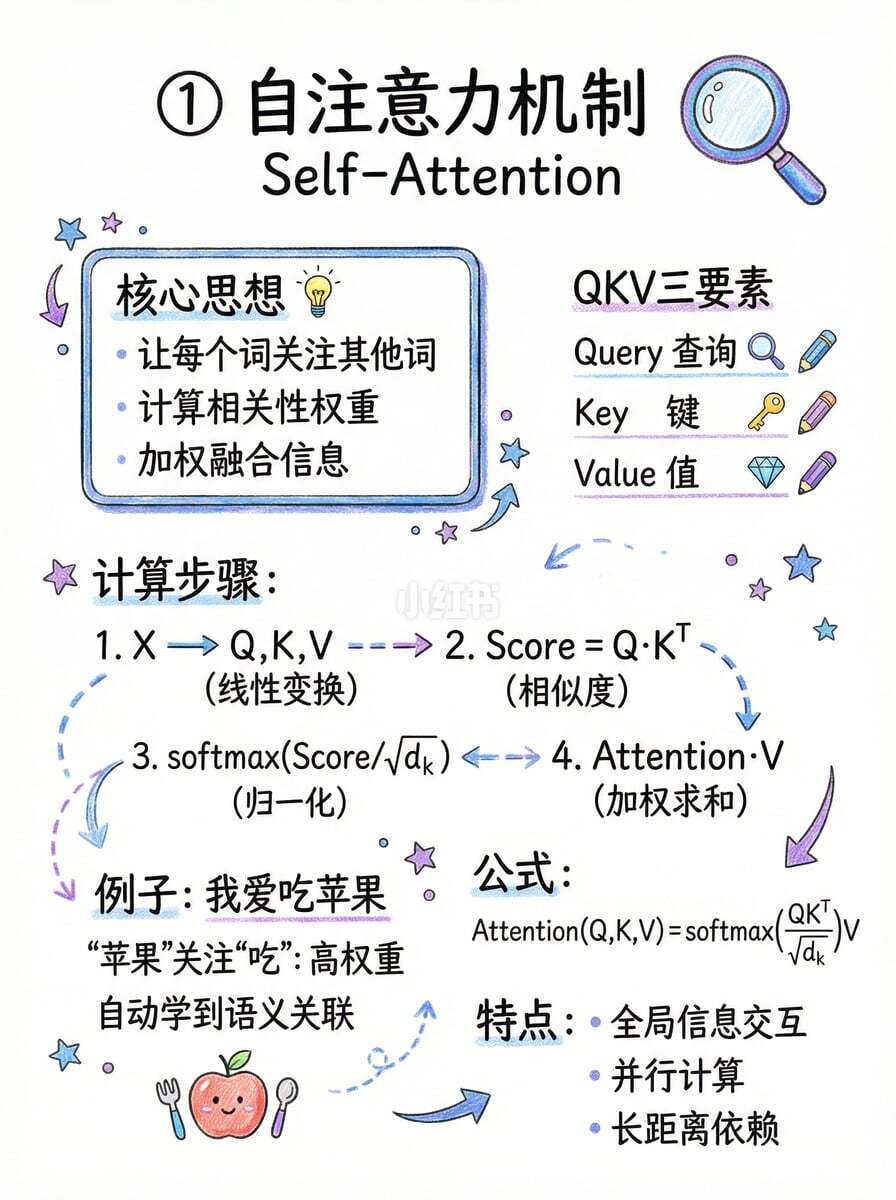

① 自注意力机制 - 全局信息交互的秘密 让序列中每个词都能关注其他所有词!通过QKV三剑客(Query查询、Key键、Value值)计算相关性权重。公式虽然看起来复杂,但本质就是:算相似度→归一化→加权求和。就像阅读时自动联系上下文,"苹果"会自动关注"吃"而不是"手机"!

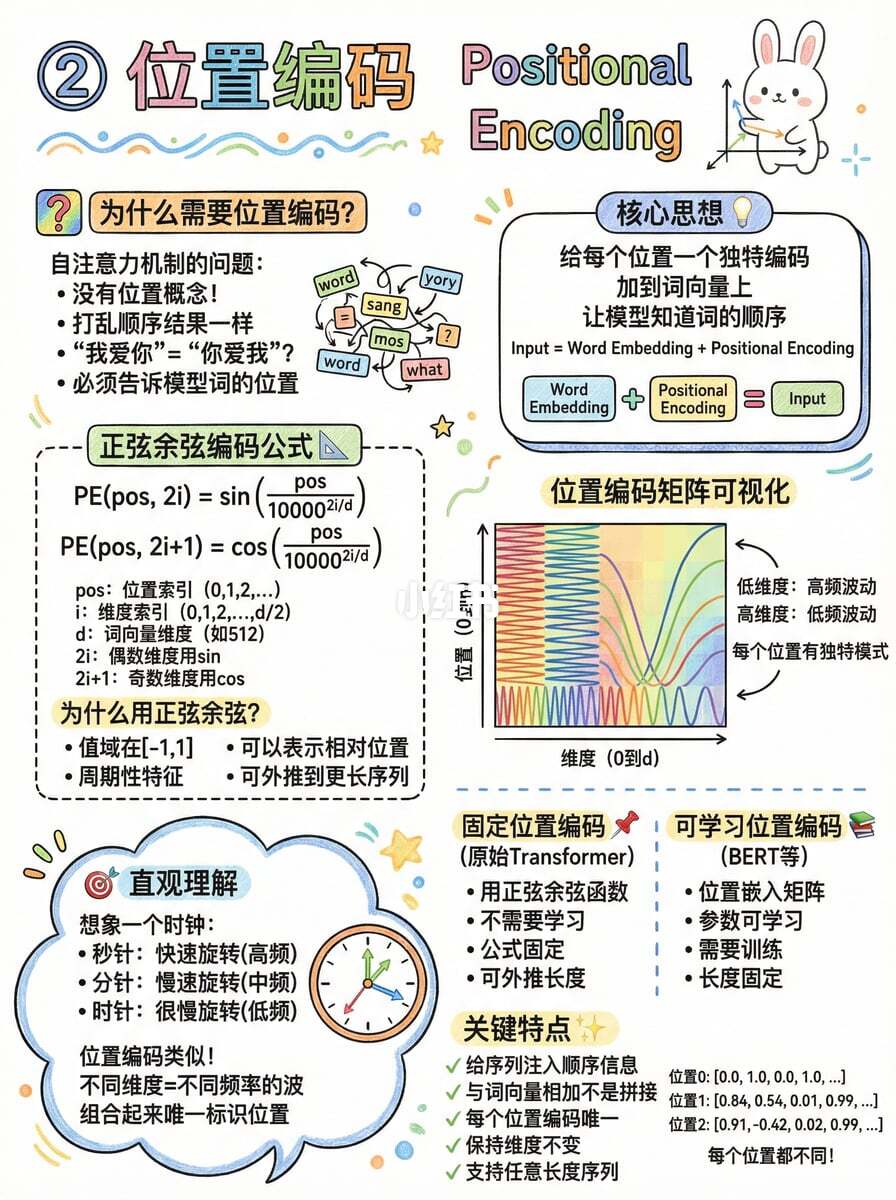

② 位置编码 - 给序列注入灵魂 自注意力机制有个致命问题:没有位置概念!打乱顺序结果一样。位置编码用正弦余弦函数给每个位置独特的"身份证",就像时钟的时分秒针,不同频率组合起来唯一标识每个位置。

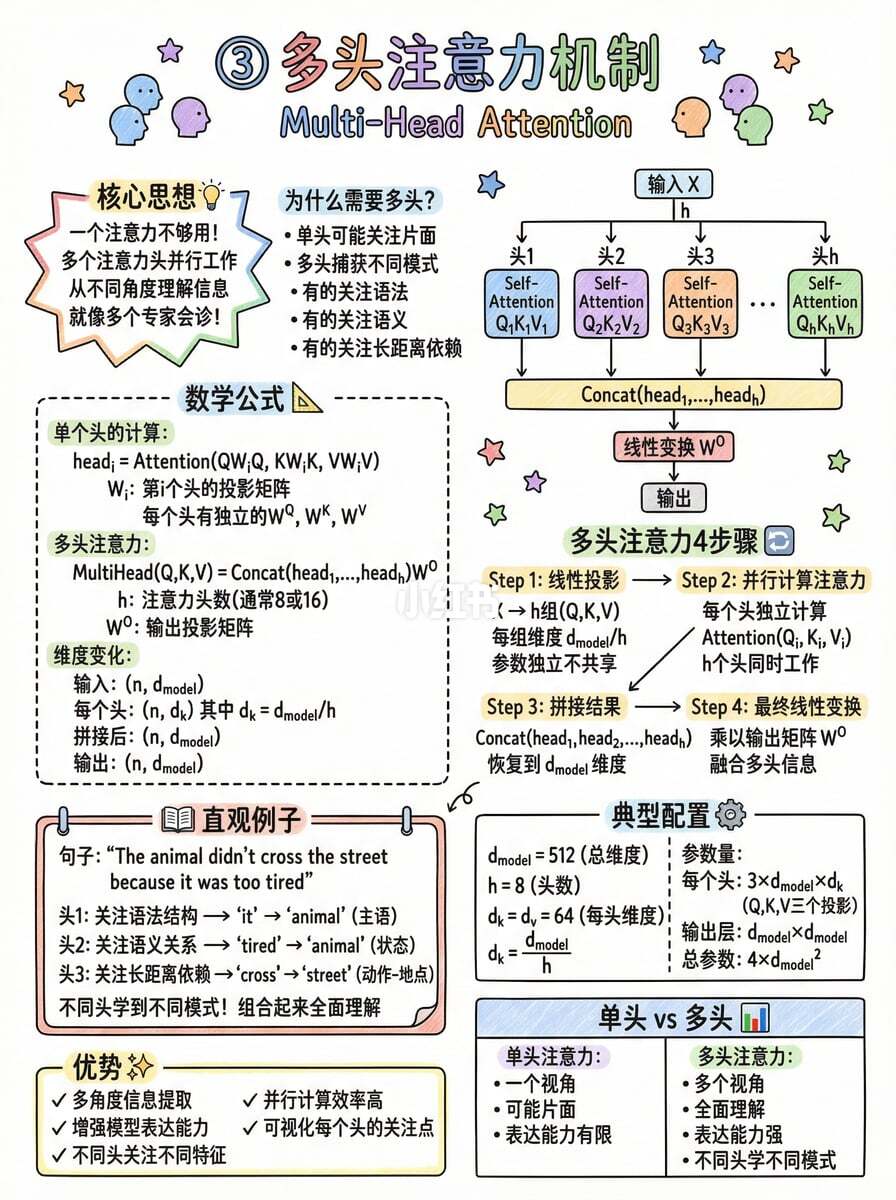

③ 多头注意力 - 多角度理解信息 一个注意力头不够用!8个头并行工作,有的关注语法结构,有的关注语义关系,有的捕捉长距离依赖。就像多个专家会诊,从不同视角全面理解句子含义。

④ 编码器-解码器架构 - 完整的翻译机器 编码器6层堆叠理解输入,解码器6层堆叠生成输出。每层都有多头注意力、前馈网络、残差连接和层归一化。编码器提取语义,解码器自回归生成,中间通过交叉注意力传递信息。

✨ 为什么这么强?

相比RNN串行处理,Transformer全并行计算,训练速度快10倍!相比CNN局部感受野,自注意力实现全局信息交互,长距离依赖不再是问题。Base模型只有65M参数,却在各种NLP任务上刷新记录。

每张手绘图都有超详细的数学公式、计算步骤、直观例子,保证小白也能看懂!收藏起来反复学习~

#深度学习 #Transformer #自注意力机制 #NLP #机器学习 #BERT #GPT #数据分析 #数据科学 #数据分析师

评论

- 数据科学家阿宝哥: Transformer到底是怎么回事儿~[派对R]

Comments NOTHING